Publicado originalmente em Agência Lupa por Evelyn Fagundes. Para acessar, clique aqui.

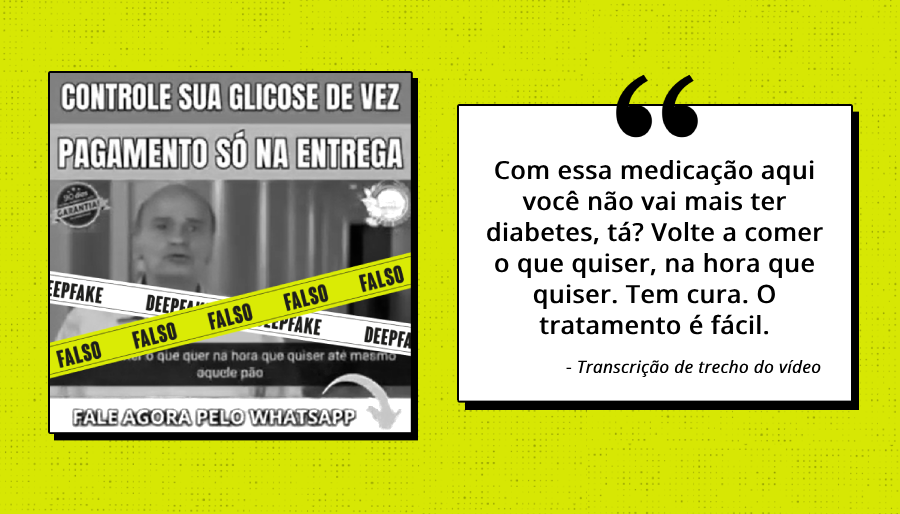

No Facebook, um vídeo do médico Drauzio Varella chama a atenção ao afirmar que chegou ao Brasil um novo medicamento que promete eliminar as dores no corpo. Nos comentários do post, usuários expressam o desejo de adquirir o produto e ter seus problemas de saúde solucionados: “Eu tenho artrose e estou mancando. O que eu mais queria era não mancar”; “Queria muito. Mal me levanto com dores na cabeça e na coluna. Tomo uma infinidade de remédios”, dizem os usuários impactados pelo post.

No entanto, o médico nunca gravou o vídeo. Trata-se de um conteúdo manipulado por Inteligência Artificial (IA). O tal “medicamento” não tem registro pela Agência Nacional de Vigilância Sanitária (Anvisa) e já foi tema de uma verificação publicada pela Lupa em abril do ano passado. No Reclame Aqui, um usuário disse que as suas dores só pioraram depois que passou a utilizar o produto.

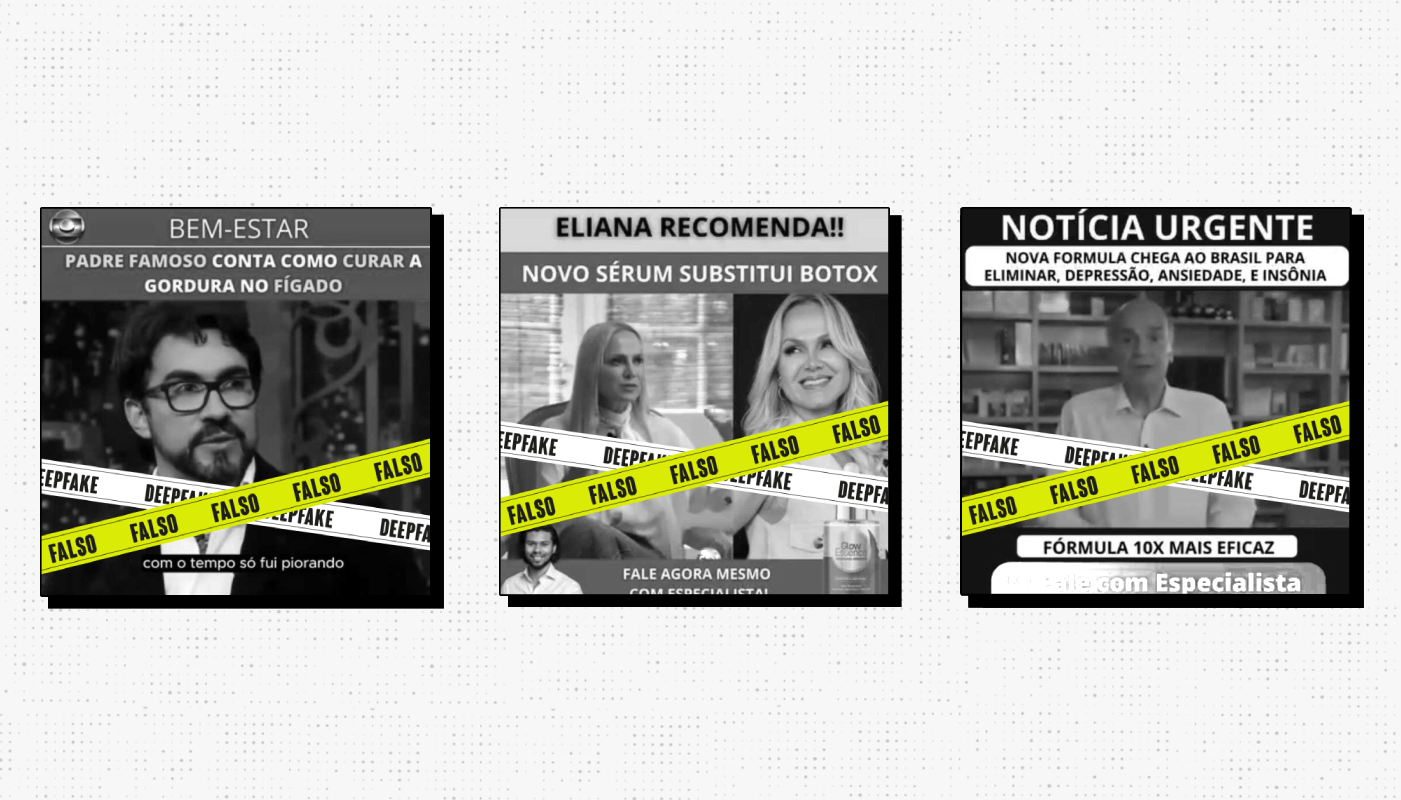

Este é apenas um exemplo de vídeo com deepfake — que utiliza a imagem de figuras públicas — publicado nas redes para promover produtos sem comprovação ou falsos.

Desde janeiro de 2024, a Meta — dona do Facebook, Instagram e Threads — de olho no período eleitoral de diversos países, inclusive do Brasil, colocou em vigor um termo de uso que exige que anunciantes divulguem o uso de inteligência artificial ao publicar anúncios sobre temas sociais, eleições ou política. O mesmo se aplica para conteúdos orgânicos – publicações não pagas – que são criados com inteligência artificial.

Porém, uma busca na Biblioteca de Anúncios da Meta – plataforma que permite verificar publicações impulsionadas por usuários, ou seja, pagas – revela uma realidade diferente.

Em levantamento realizado em novembro de 2024, a Lupa identificou, em apenas cinco dias, 298 anúncios no Facebook criados com Inteligência Artificial (IA) e publicados sem qualquer indicação sobre o uso da tecnologia.

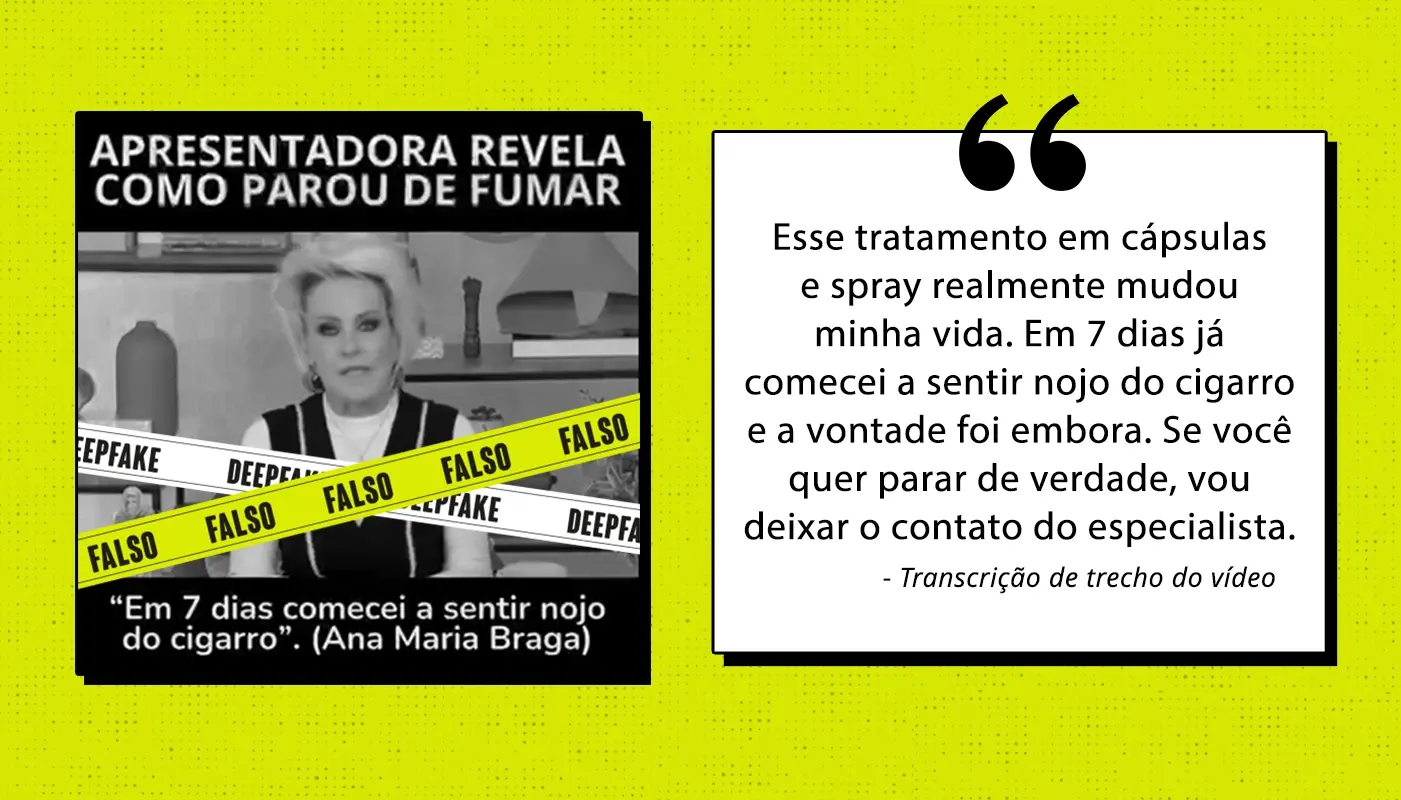

Os conteúdos manipulam as imagens de figuras públicas como os apresentadores Ana Maria Braga, Celso Portiolli, César Tralli, Eliana, Fátima Bernardes, Ratinho e Rodrigo Faro; o deputado federal Celso Russomanno (Republicanos-SP); as cantoras Simone Mendes e Maiara; os padres Fábio de Melo e Marcelo Rossi; e o ex-jogador D’Alessandro – e se passam por narrativas realistas, sem qualquer aviso de que utilizam IA, para divulgar produtos que prometem curas milagrosas para doenças e distúrbios, além de sites que se passam por fontes seguras, mas aplicam golpes.

O rótulo que indica o uso de IA em uma publicação é como um alerta, um aviso para o usuário de que nem tudo naquele post é real. E em casos como o do vídeo falso com a imagem do Dr. Drauzio, pode ajudar as pessoas a desconfiarem da veracidade das promessas milagrosas feitas nas redes sociais.

Pollyana Ferrari, professora do Programa de Estudos de Pós-Graduados em Tecnologias da Inteligência e Design Digital (TIDD), da Pontifícia Universidade Católica de São Paulo (PUC-SP), destaca que a falta de regulação desse tipo de conteúdo falso por parte da Meta é potencialmente perigosa para os usuários. “Estamos vendo que essas tecnologias de inteligência artificial têm avançado de forma a ficar cada vez mais verossímil de um vídeo real. O cidadão comum não consegue identificar essa desinformação”, afirma

Em um dos vídeos, o médico Dráuzio Varella recomenda um medicamento falso que promete acabar com o diabetes. Foto: Reprodução.

Quando o rótulo de IA é exigido?

Segundo a Meta, a empresa tem um sistema que identifica automaticamente conteúdos criados por anunciantes que utilizam os recursos de IA próprios da plataforma – ferramentas que ajudam a gerar planos de fundo ou uma imagem. A big tech também explica que disponibiliza uma opção para que os anunciantes informem quando o anúncio contém mídia criada ou alterada digitalmente. Quando essa divulgação é feita, um rótulo com a indicação “Criação digital” aparece próximo ao aviso “Pago por” no anúncio.

Já para conteúdos produzidos por outras ferramentas de IA, a Meta alega que a empresa também pode exigir que anunciantes “divulguem quando anúncios forem criados ou modificados com ferramentas de IA de terceiros”. Contudo, não fica claro, nos artigos disponibilizados pela Meta aos usuários, como a plataforma identifica esses conteúdos. A Lupa fez esse questionamento à big tech, mas como resposta recebeu apenas uma nota dizendo que “no momento, tudo o que a Meta tem para compartilhar sobre o assunto está nos links que foram enviados [à reportagem] anteriormente”.

Em um dos artigos enviados à Lupa, originalmente publicado em fevereiro de 2024, a plataforma diz: “é importante ajudarmos as pessoas a compreender quando o conteúdo fotorrealista que estão vendo foi criado utilizando a IA. Fazemos isso aplicando rótulos de ‘Criados com IA’ a imagens realistas que foram criadas com o uso do recurso da IA da Meta, mas queremos poder fazer isso também com conteúdos criados com ferramentas de outras empresas”, no entanto não detalha como nem quando fará essa identificação.

A empresa afirma ainda no artigo que “continuaremos a rever a nossa abordagem, colaborando com nossos pares da indústria e seguindo em diálogo com governos e sociedade civil”, no entanto, um ano depois do anúncio, ainda não é possível entender se os rótulos estão de fato sendo exigidos ou aplicados. E se há algum tipo de penalização para quem publica um anúncio que usa IA no conteúdo sem fazer a devida notificação disso.

Como pesquisadora, Pollyana Ferrari disse que desconhece qual a metodologia utilizada pela Meta para mapear anúncios que não estão em conformidade com os termos de uso, entendendo que, provavelmente, se trata de uma informação não divulgada publicamente, mas uma orientação interna. A Lupa procurou por artigos publicados pela plataforma para entender se há transparência quanto a essas informações, no entanto, não identificou nenhum texto público sobre o assunto.

No feed do Facebook, a rotulação de IA deveria aparecer após o usuário procurar por detalhes daquele post. Foto: Reprodução

Há também dúvidas sobre quais conteúdos podem estar entre os monitorados pela plataforma. No termo de uso, a Meta fala em anúncios sobre temas sociais, eleições ou política. Por “temas sociais”, a plataforma entende os “tópicos sensíveis muito discutidos, que podem influenciar o resultado de uma eleição ou gerar/relacionar-se a um projeto de lei ou a uma legislação”. A empresa delimita que, para o Brasil, os seguintes pontos são temas sociais: Direitos civis e sociais; crime; economia; educação; política ambiental; armas; saúde; imigração; valores políticos e governança, além de segurança e política exterior.

No entanto, nos anúncios identificados pela Lupa, não há nenhuma marcação que indique que o conteúdo trata de “temas sociais, eleições ou política” – identificação essa que deve ser feita pelo próprio anunciante e que facilitaria, na teoria, o monitoramento da empresa. Apesar disso, as publicidades utilizam a imagem do político Celso Russomanno e abordam “temas sociais” como saúde.

Das promessas de dinheiro à cura milagrosa

Em uma análise geral, as publicações manipuladas identificadas no levantamento se concentram em quatro principais temáticas: promessas de dinheiro fácil ou resgate de valores atrelados ao CPF; promoções com altos descontos em produtos; distribuição gratuita de itens como uma forma de prêmio; e a oferta de medicamentos que afirmam melhorar a saúde – seja mental ou física.

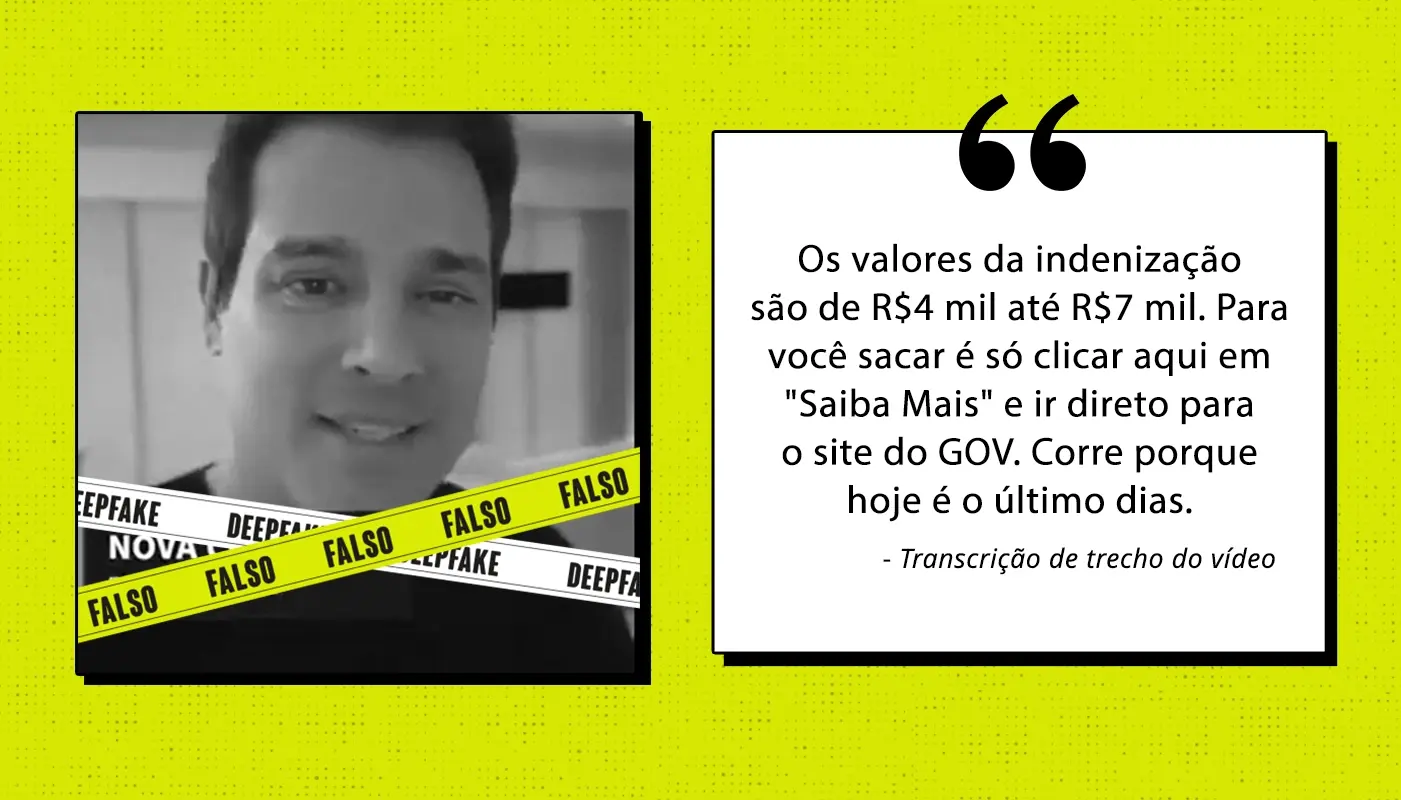

Pouco mais da metade dos vídeos falsos sem rótulo de IA tratavam sobre promessas de conseguir dinheiro de forma fácil

A maior parte dos vídeos analisados foca no suposto resgate de valores vinculados ao CPF. Esse tipo de conteúdo frequentemente exibe imagens manipuladas de apresentadores como César Tralli, Celso Portiolli, Fátima Bernardes e Rodrigo Faro. Nos conteúdos – que já foram verificados pela Lupa –, os famosos aparecem afirmando que é possível consultar valores a receber por meio de um site. No entanto, ao acessar o portal indicado, é possível verificar que se trata de um golpe.

Os sites que promovem o “resgate de valores” se passam por portais governamentais, utilizando logotipos e símbolos oficiais. Em geral, eles alegam que o usuário possui indenizações pendentes ou benefícios a receber. No entanto, os sites não possuem qualquer vínculo com órgãos federais. Essas páginas solicitam dados pessoais e, posteriormente, alegam que, para liberar a quantia prometida, é necessário o pagamento de uma taxa superior a R$40. Essa tarifa, no entanto, não garante a liberação de qualquer valor. É apenas uma forma de golpistas extorquirem dinheiro das vítimas.

No conteúdo falso, a voz de Celso Portiolli é manipulada para fazer com que ele promova um site que se passa pelo governo e promete que cidadãos possam resgatar valores

Em alguns casos, ao acessar esses sites, o próprio navegador alerta que a URL é suspeita por phishing: “Este website foi denunciado por risco potencial de phishing. O phishing ocorre quando um site tenta roubar informações sensíveis se passando por uma fonte segura”.

Em segundo lugar, depois dos vídeos que prometem dinheiro fácil, os conteúdos sobre saúde foram os que mais apareceram no levantamento. Na maioria dos casos, a imagem do médico Drauzio Varella foi manipulada para promover medicamentos ou suplementos. Vídeos de outras personalidades também foram adulterados para simular depoimentos sobre o uso dos produtos anunciados, como os das apresentadoras Ana Maria Braga, Eliana e dos padres Fábio de Melo e Marcelo Rossi.

Os conteúdos promovem supostos tratamentos para diversas condições, incluindo perda de peso, dores nas articulações, rejuvenescimento da pele, melhora da audição, prisão de ventre, hemorróidas, gordura no fígado, ansiedade, depressão, tabagismo, insônia, distúrbios do aparelho reprodutor e até diabetes.

As narrativas exploradas nos conteúdos abordam temas sensíveis para pessoas que convivem com esses problemas de saúde e buscam por uma solução. Além dos vídeos falsos, os posts analisados se baseiam em histórias falsas para embasar promessas de cura para ansiedade, depressão e diabetes, sendo que não existe cura para tais doenças. A Lupa já publicou reportagens sobre conteúdos semelhantes que prometiam curar transtornos mentais e outro que falava em cura para o diabetes.

No conteúdo falso, a voz de Celso Portiolli é manipulada para fazer com que ele promova um site que se passa pelo governo e promete que cidadãos possam resgatar valores

O levantamento também identificou vídeos que prometiam prêmios e descontos. Em um post, deepfakes dos apresentadores Ratinho e Rodrigo Faro foram usadas para afirmar que o Mercado Livre estaria promovendo uma oferta de smartphones. Segundo a narrativa falsa, um celular de mais de R$ 1.000 estaria sendo vendido por R$ 96,90. A Lupa verificou o conteúdo e se tratava de um golpe.

Por ter sido realizada na segunda metade de novembro de 2024, a apuração também identificou conteúdos sazonais, relacionados à Black Friday e ao Natal. Um vídeo manipulado do dono da Havan, Luciano Hang, circulou nas redes com a alegação de que seria possível conquistar produtos de forma gratuita no site da loja. Já uma filmagem deturpada do apresentador Rodrigo Hilbert prometia que seria poderia garantir um kit de natal com diversos produtos da empresa, o que também era falso. A Lupa identificou o vídeo original que foi utilizado para a deepfake, em que o apresentador parabeniza a marca de eletrodomésticos Mondial.

No Reclame Aqui, usuário questiona a Havan sobre o desconto de 100% que havia recebido em um site falso. A empresa responde que a pessoa não acessou a página oficial, mas um portal clonado

“O impacto dessas desinformações é gigantesco e a Meta não me parece preocupada”, afirma Ferrari. Ela também enxerga com receio o anúncio feito pelo CEO da Meta, Mark Zuckerberg, no início de janeiro, sobre o fim do sistema de checagem de fatos nas redes sociais da empresa. “Na minha visão de pesquisadora e educadora, as plataformas têm a obrigação de zelar pela democracia, auto-regular tudo o que trafega pelas plataformas. Mas, o que estamos vendo com o fim da checagem de fatos na Meta é exatamente o contrário”, pontua Pollyana Ferrari.

Para a pesquisadora, quando um usuário é enganado por vídeos produzidos com IA em uma rede social, isso aponta para um problema que vai além da perda financeira, significa a falta de capacidade do usuário para avaliar de forma crítica o que circula nas redes. “É importante que os usuários desconfiem de tudo, tudo mesmo que esteja sendo oferecido, como os remédios milagrosos. Precisamos aprender a checar as fontes antes de comprar, ler ou assinar qualquer oferta ou serviço. Na era atual, onde a inteligência artificial permeia o dia a dia, não podemos ser inocentes e acreditar sem checar”, pontua a professora da PUC-SP.

A Lupa perguntou à Meta qual é o regulamento da plataforma para combater anúncios com histórias falsas criadas com deepfake. Como resposta, a empresa enviou apenas o link de um artigo, publicado no dia 3 deste mês. O texto fala sobre tratamento dado pela Meta a anúncios criados com os recursos de inteligência artificial da própria plataforma (já explicado nesse texto), sem mencionar conteúdos gerados com IA de outros sites.

Ferramentas identificam deepfakes

Em alguns dos vídeos identificados pela Lupa, pode-se identificar sinais de que os conteúdos foram gerados com inteligência artificial. Erros comuns em que a fala não acompanha o movimento dos lábios, baixa qualidade da gravação e distorções no áudio, que soa de modo robótico e, por vezes, apresenta alterações bruscas de volume.

Para aprofundar a análise, a reportagem utilizou a Hive – ferramenta que auxilia na detecção de conteúdos gerados por IA – mas que ainda apresenta limitações. Como a Lupa já mostrou em uma reportagem que testou diferentes tecnologias que se propõem a fazer essa identificação, algumas delas não conseguem detectar com precisão o uso de inteligência artificial em 100% dos casos.

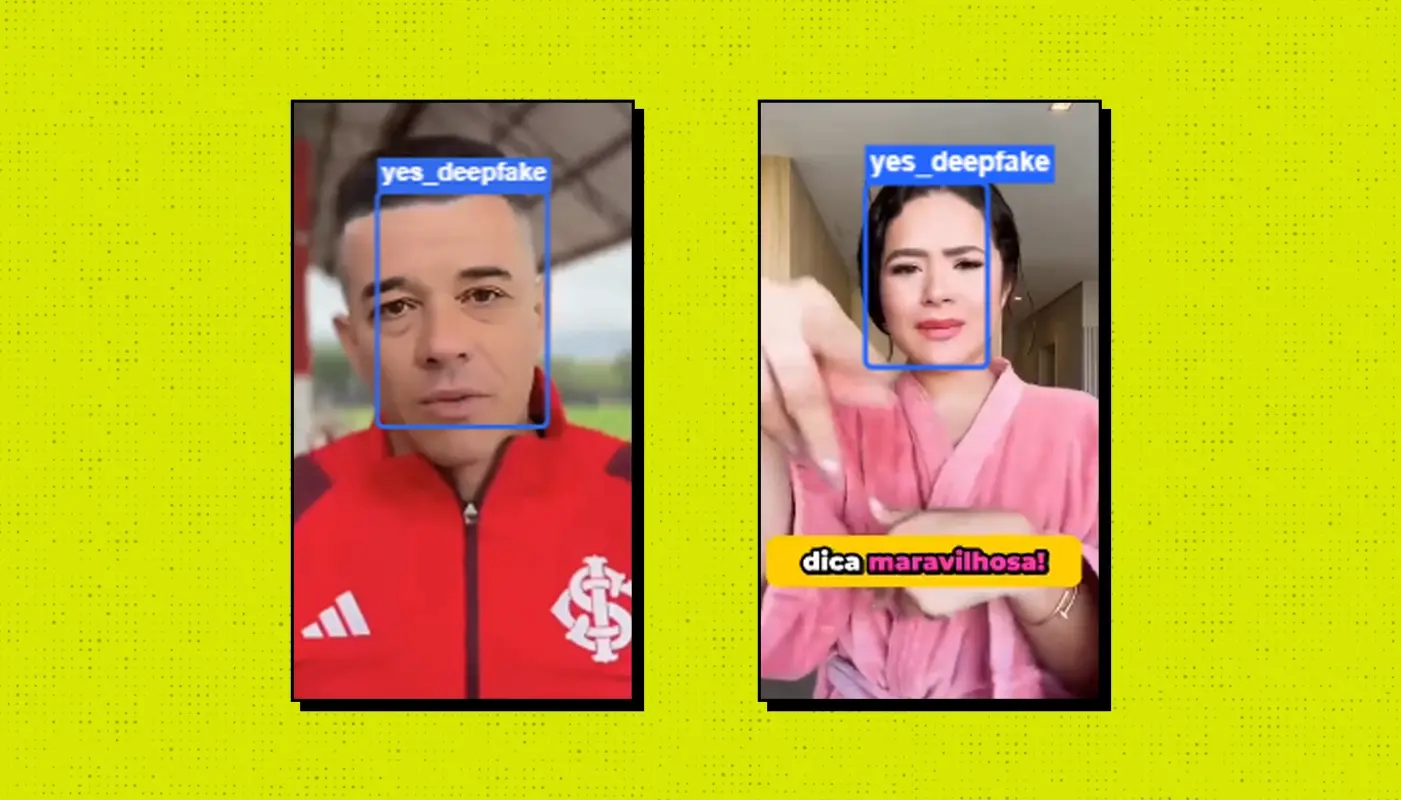

Plataforma Hive detectou que os rostos de D’Alessandro e Maisa foram modificados com deepfake nos vídeos

Ainda assim, a Hive identificou o uso de IA em parte dos conteúdos. Um dos exemplos foi um vídeo deepfake do ex-jogador D’Alessandro, no qual ele supostamente afirmava que os torcedores poderiam ganhar uma camiseta do Internacional autografada por ele ao responder um quiz sobre o clube. Trata-se de um golpe. Ao final é cobrado um valor de “frete” pela camiseta.

A plataforma também identificou deepfake em um vídeo que utilizou a imagem da atriz Maisa Silva. Na gravação manipulada, a atriz afirma que Silvio Santos, antes de morrer, teria pedido a ela para sempre ajudar as pessoas e, por isso, resolveu recomendar uma “dica maravilhosa”, um aplicativo chamado “Cupom da vez”, onde é possível ganhar dinheiro inserindo números de notas fiscais. No site do Reclame Aqui, existem mais de oito mil reclamações envolvendo o nome “Cupom da vez”.

No Reclame Aqui, usuário diz que foram lhe cobradas diversas taxas para utilizar o aplicativo que prometia dinheiro fácil