Publicado originalmente em Aos Fatos por Ethel Rudnitzki. Para acessar, clique aqui.

Parceria com checadores encerrada pela Meta nos Estados Unidos não faz parte da estrutura de moderação da plataforma;

Checagem, feita por profissionais ligados a organizações jornalísticas, identifica postagens falsas e enganosas; elas são sinalizadas e têm o alcance reduzido por decisão da plataforma;

Moderação é feita por inteligência artificial ou equipes contratadas pela Meta para identificar publicações que violam suas diretrizes; podem ser removidas ou ter o alcance reduzido;

Parceria com checadores ajudou a combater desinformação nas redes ao longo dos últimos anos.

Na última terça-feira (7), a Meta — dona de Instagram, WhatsApp, Facebook e Threads —, anunciou o fim do programa de checagem de fatos nos Estados Unidos como parte das mudanças adotadas pela plataforma em sua política de moderação.

Iniciado em 2016, o programa firmou parceria com organizações de checagem de fatos em mais de 80 países — entre elas o Aos Fatos —, que ajudam a desmentir e contextualizar publicações enganosas que circulam nas plataformas da empresa. Esse trabalho de checagem, contudo, não faz parte da política de moderação de conteúdo da plataforma.

“[Mark] Zuckerberg faz uma confusão deliberada entre o que é o programa de checadores e a estrutura de moderação de conteúdo”, disse Iná Jost, coordenadora de pesquisa do InternetLab, em entrevista ao Aos Fatos.

“Ele dá a entender que os checadores têm ingerência direta na circulação de conteúdo — no que vai circular, no que vai ser alcançado, no tamanho do alcance, no que vai ser retirado, no falso positivo, no falso negativo —, quando, na verdade, os checadores servem como um apoio a essa grande engrenagem que é a moderação de conteúdo.”

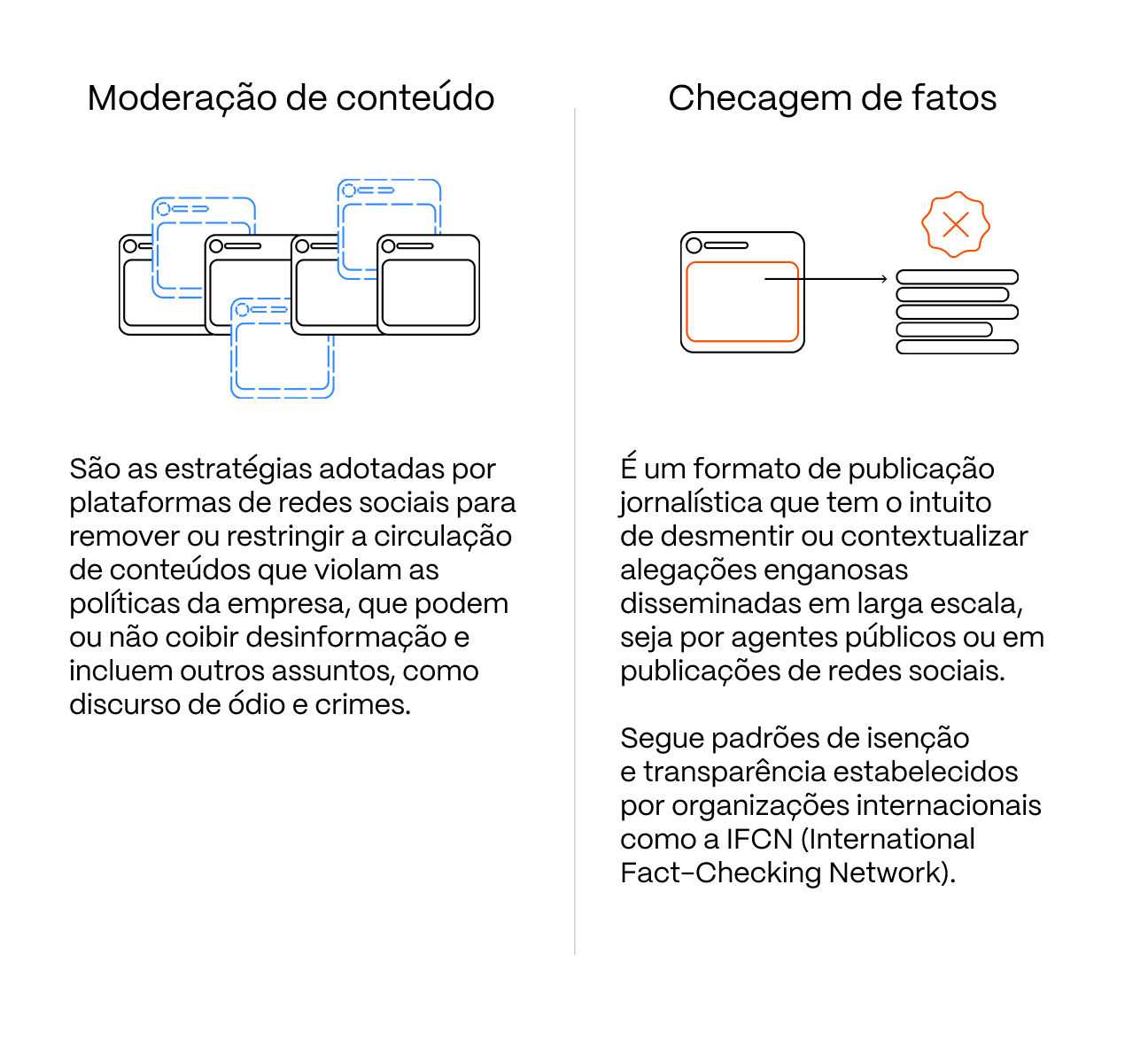

Entenda nos três tópicos a seguir a diferença entre as duas coisas:

1. Definição

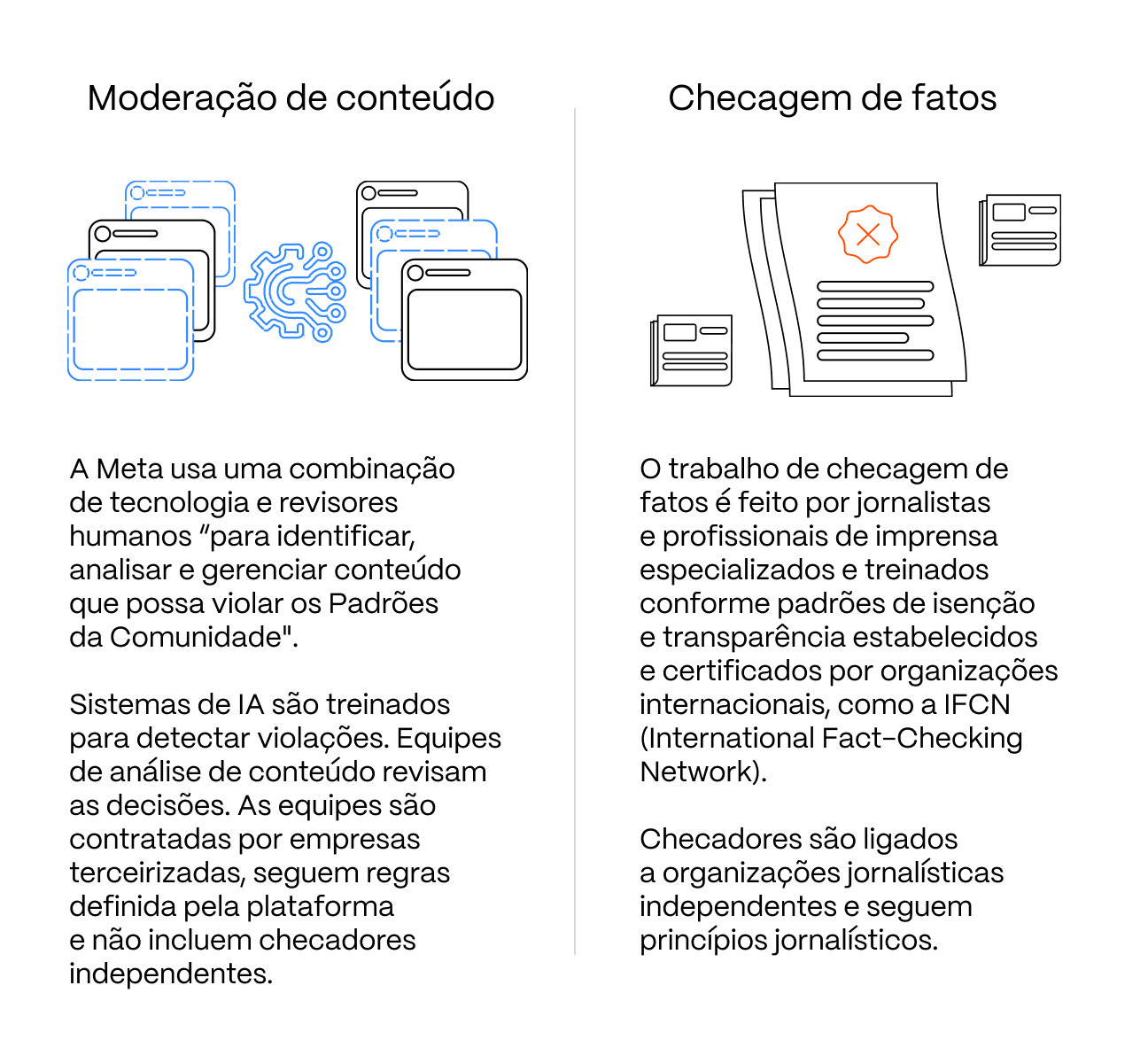

2. Responsáveis

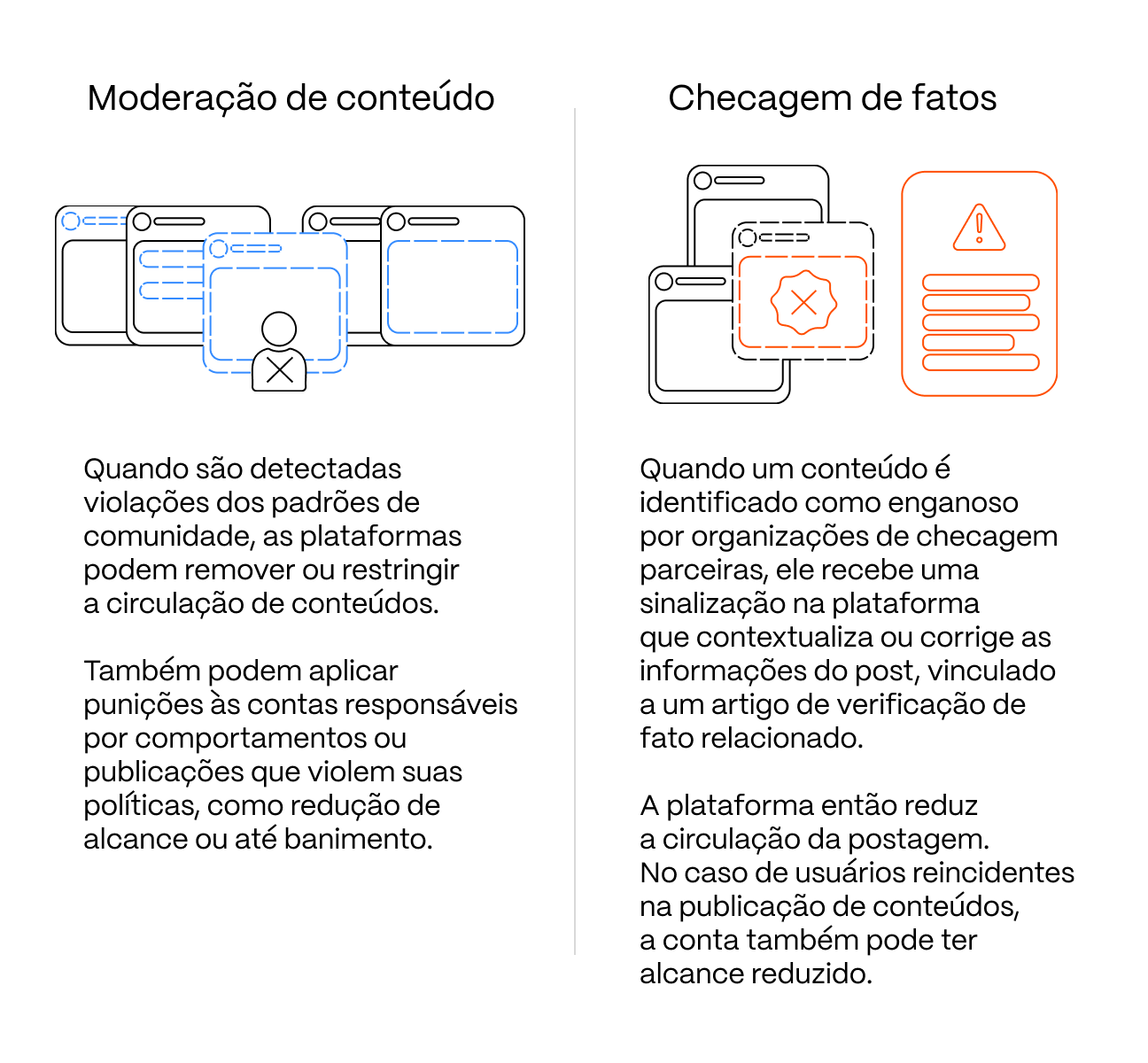

3. Impacto

Siga o canal do Aos Fatos no WhatsApp e receba nossas checagens e reportagens

Contexto. Conforme explica a empresa em guia publicado no site oficial, a parceria com checadores de fato funciona em três etapas:

- A plataforma identifica notícias potencialmente falsas com uso de sistemas de inteligência artificial e envia aos checadores;

- Os checadores analisam essas e outras publicações com possível desinformação e classificam os conteúdos com etiquetas, a partir da metodologia da checagem de fatos;

- A plataforma reduz a distribuição de posts classificados como falsos e fornece mais contexto, direcionando as postagens ao artigo de checagem de fatos relacionado ao tema.

“O Facebook remove conteúdo quando ele viola os nossos Padrões da Comunidade, que é algo separado do nosso programa de verificação de fatos”, ressalta a própria empresa ao explicar a parceria com os checadores.

Dados sobre o número de checagens realizadas durante o período da parceria são escassos, mas os disponíveis ao longo do tempo indicam que o programa foi eficaz no combate à desinformação e bem aceito pelo público:

- Em 2018, a Meta informou que a estratégia reduziu em mais de 80%as visualizações futuras de posts marcados como desinformativos;

- Em 2021, a empresa revelou que 74% dos usuários que viram postagens marcadas como enganosas na plataforma julgaram ter visto a quantidade certa ou estavam abertos a ver mais avisos sobre informações falsas.

- Dessas, 63% julgaram as classificações como corretas.

“Sabemos que o programa está funcionando e que as pessoas valorizam os avisos que aplicamos ao conteúdo depois que um parceiro de verificação de fatos o classificou”, informou a empresa em 2021.O caminho da apuração

Aos Fatos levantou informações sobre os sistemas de moderação de conteúdo em comunicados e guias oficiais da Meta e comparou com as definições de checagem de fatos estabelecidas por organizações internacionais. Também contextualizamos o funcionamento da parceria entre checadores de fatos independentes e levantamos dados disponíveis sobre o resultado do programa.

Referências